RAG深入解析:打造更智能的AI响应系统

RAG深入解析:打造更智能的AI响应系统

一、什么是RAG?二、为什么要使用RAG?三、RAG架构及原理详解3.1 RAG架构图3.2 RAG原理详解3.2.1 数据准备阶段3.2.2 数据检索阶段3.2.3 数据增强阶段:3.2.4 数据生成阶段: 四、总结

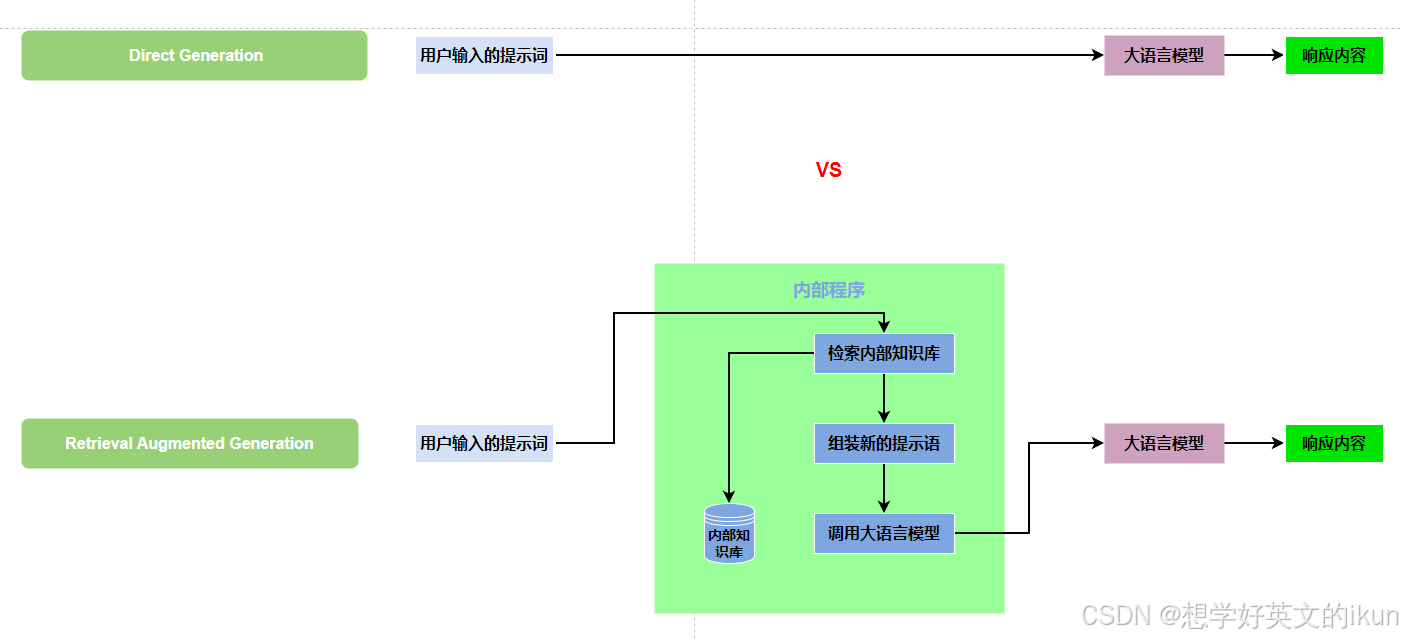

一、什么是RAG?

RAG(Retrieval-Augmented Generation,检索增强生成)是一项先进的人工智能技术,它巧妙地结合了信息检索和语言生成模型的功能。这种技术首先从广泛的外部知识库中检索出与查询相关的信息,然后将这些信息作为输入提示,提供给大型语言模型(LLMs)。通过整合这些外部知识,LLMs能够生成更精确、更及时且更符合特定场景需求的文本。RAG的核心优势在于它能够利用外部的知识资源,增强语言模型的生成能力,从而产生更加丰富和准确的内容。

二、为什么要使用RAG?

当我们将大模型应用于实际业务场景时会发现,通用的基础大模型基本无法满足我们的实际业务需求,主要有以下几方面原因:

知识的局限性:传统的大型语言模型,如ChatGPT或文心一言,其知识库仅限于训练时的数据集,这些数据大多来源于互联网公开信息。对于需要实时更新的信息或非公开的数据,这些模型往往显示出能力的局限性。RAG通过动态检索最新和特定的数据源,弥补了这一缺陷,使得生成的内容更加准确和时效性强。

幻觉问题的缓解:所有基于概率的AI模型在处理超出其训练范围的问题时可能会产生不准确甚至误导性的答案。RAG模型通过引入实时检索的外部数据,可以有效减少这种“幻觉问题”,提供更加可靠的输出。

数据安全与隐私保护:在数据泄露和隐私侵犯频发的今天,将敏感数据上传到云端存在极大的风险。RAG允许企业在保障数据安全的前提下,本地化处理所有数据,确保信息的保密性,同时依然能够利用AI的强大计算能力。

应对高时效性问题:对于需要实时数据支持的应用场景,例如市场动态分析、即时新闻生成等,传统的大模型由于数据更新的滞后性常常无法满足需求。RAG通过实时检索最新信息,能够即时反映环境变化,增强决策支持的准确性。

三、RAG架构及原理详解

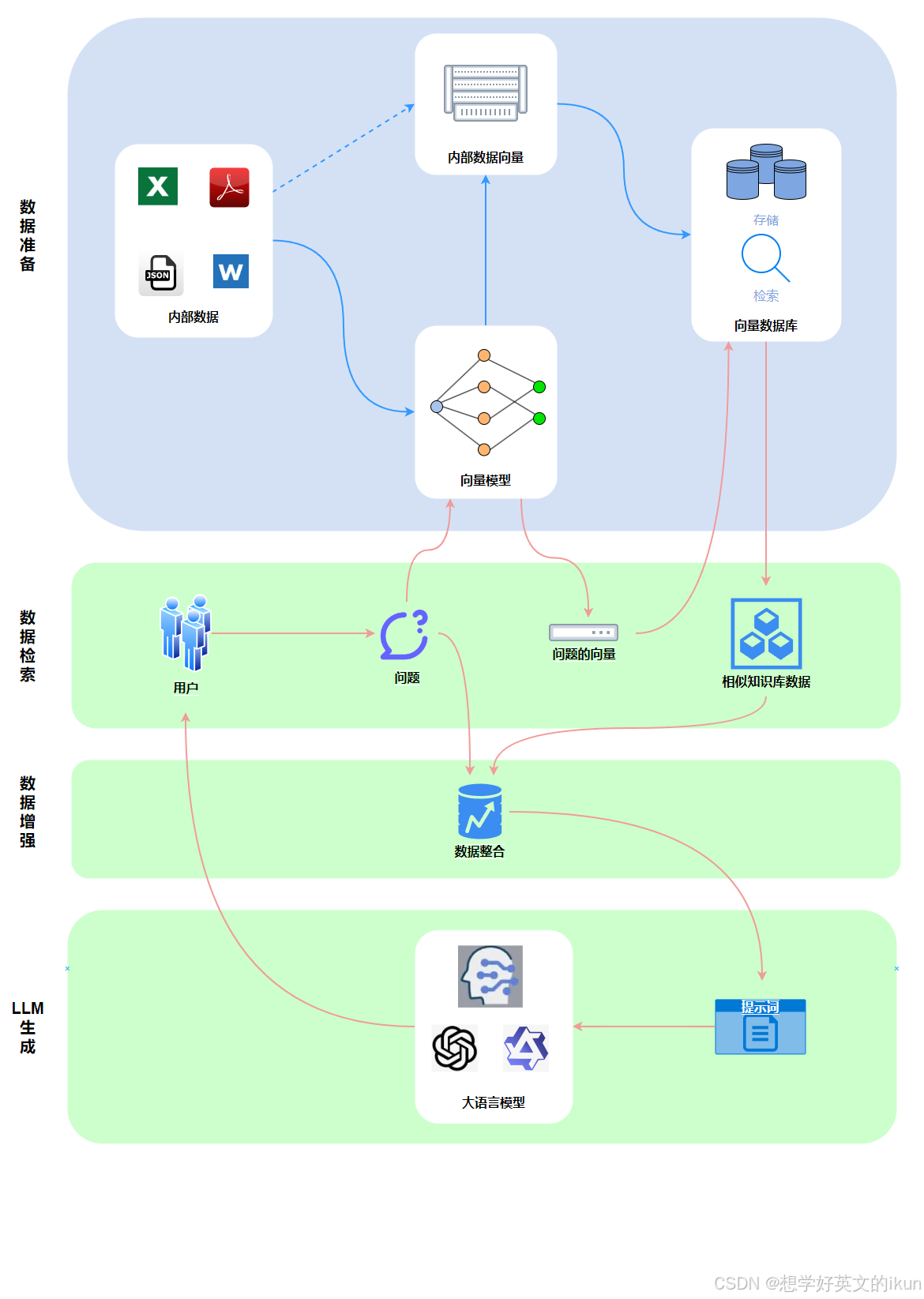

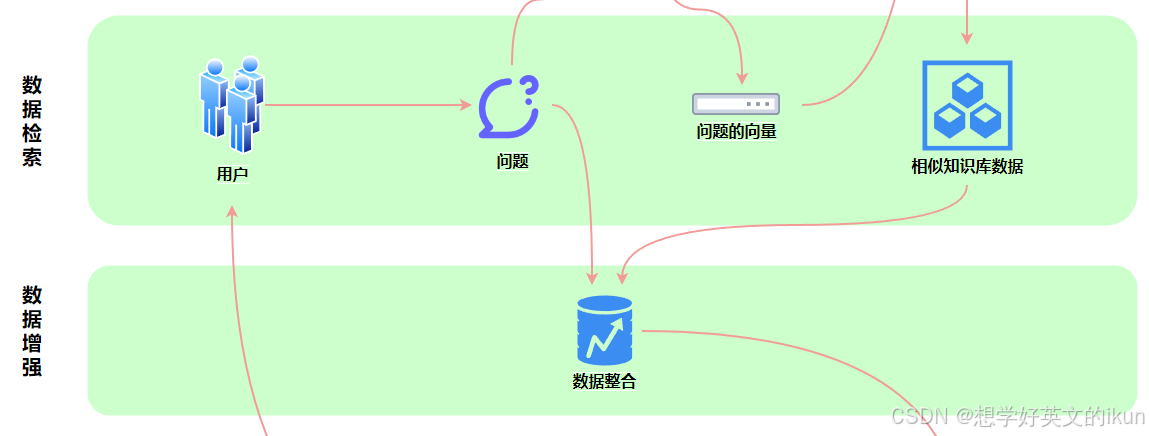

3.1 RAG架构图

3.2 RAG原理详解

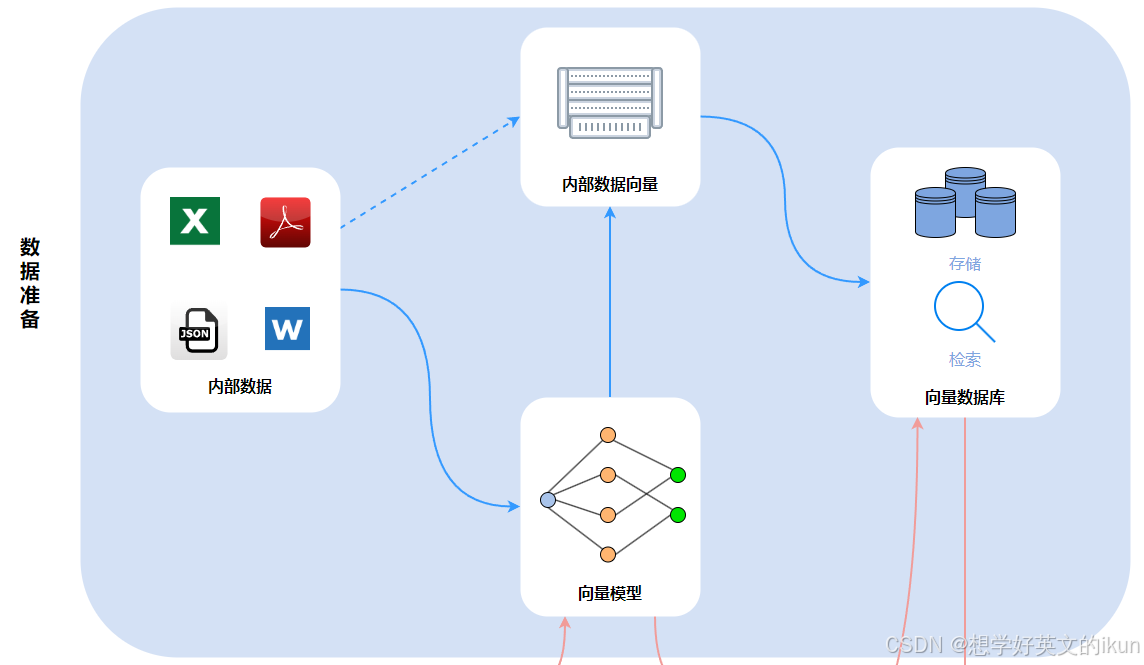

3.2.1 数据准备阶段

数据准备通常是在离线环境中进行的,其目的是为后续的检索和生成过程建立必要的知识支撑。这个阶段包括以下几个关键步骤:

数据加载: 首先,需要从各种数据源加载多种格式的数据。这一步骤需要将异构数据统一处理成一致的格式,以便后续操作。数据清洗: 数据经过清洗和预处理,包括过滤无关信息、去除噪声、重复项、压缩数据以节省存储空间,确保数据的质量和准确性。元数据提取: 从数据中提取关键的元信息,如文件名、标题、创建日期等,这些信息在后续的索引和检索中起到辅助作用。文本分割: 根据文本内容的特点和技术要求,将文本分割成合适的段落。这一步骤关注于保持语义的完整性和适应模型的Token限制,常见的方法包括按句子切分和按固定Token数量切分。向量化(Embedding): 文本向量化是将文本转换为数值向量的过程,这些向量后续将用于构建索引。根据具体的应用场景,可以选择使用通用的Embedding模型或对特定模型进行微调,以优化检索和生成的效果。数据入库: 向量化后的数据需要构建索引并存储于数据库中。针对RAG场景,常用的数据库解决方案包括FAISS、Redis、Chromadb、Elasticsearch(ES)、Milvus等,选择哪一种通常取决于业务需求、预算和硬件条件。3.2.2 数据检索阶段

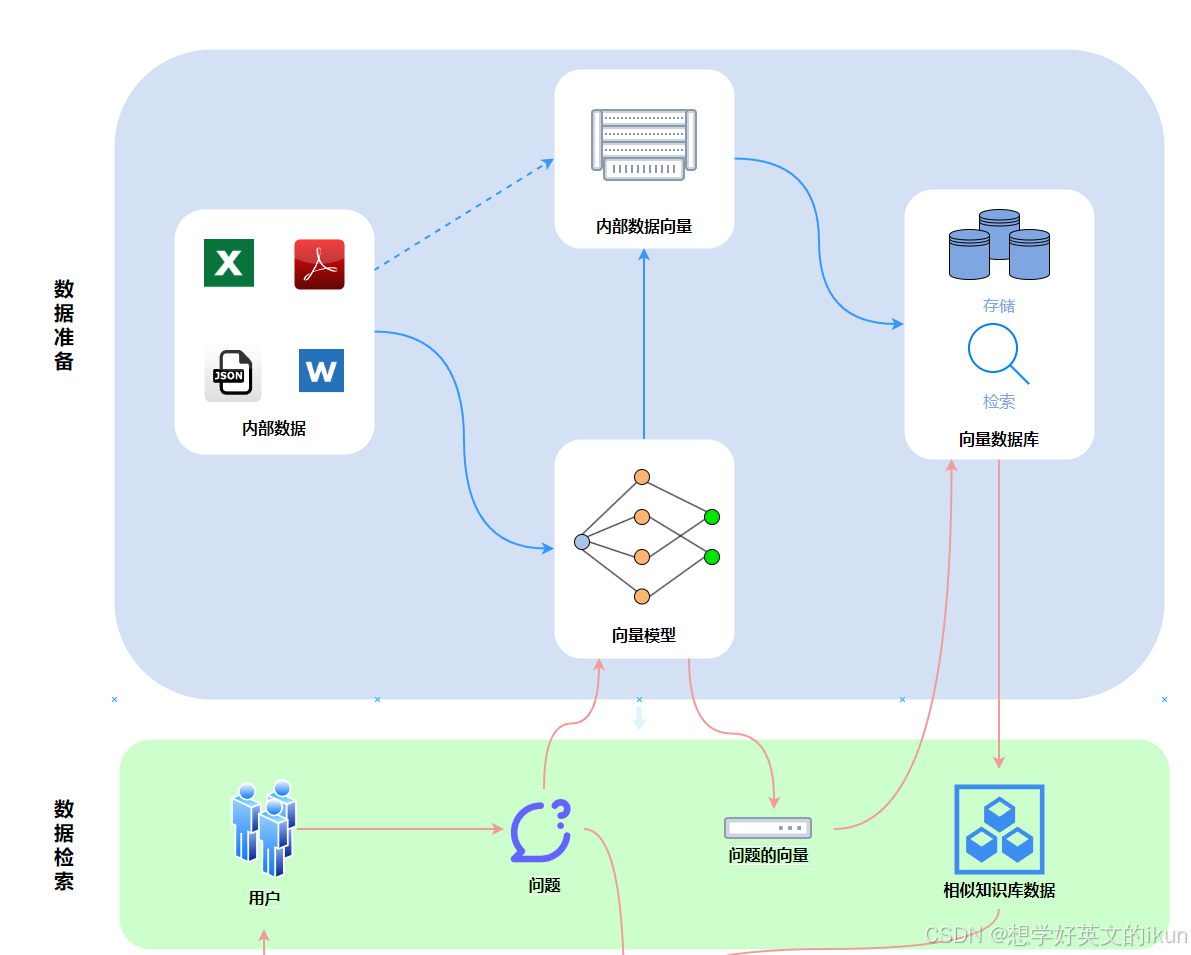

数据检索阶段是核心环节之一,负责从向量数据库中精确地挑选出与用户查询最相关的信息片段,为后续的生成过程提供有用的上下文信息。该阶段主要包括以下几个步骤:

问题向量化: 用户提交的查询首先通过与数据准备阶段相同的向量模型转化为向量形式。这一步确保了查询向量与数据库中存储的向量在同一语义空间内,便于后续的相似度计算。相似度检索: 利用向量化的查询,在向量数据库中进行高效的相似度搜索。这通常涉及到余弦相似度、欧氏距离或曼哈顿距离等度量方法,以识别出与查询向量最相似的知识片段。结果排序: 检索出的数据片段会根据相似度得分进行排序。我们可以选择排名靠前的一个或多个片段,用于后续的生成阶段。3.2.3 数据增强阶段:

数据增强阶段是RAG系统中提高响应质量的关键环节,将检索到的信息用作生成模型(即大语言模型)的上下文输入,以增强模型对特定问题的理解和回答能力。这一步的目的是将外部知识融入生成过程中,使生成的文本内容更加丰富、准确和符合用户需求。该阶段包括以下几个步骤:

上下文融合: 在此阶段,将检索到的相关信息片段与用户的原始查询合并,以此形成一个信息更加丰富的上下文环境。这不仅增强了模型对问题的理解,也为生成更准确的答案提供了支持。Prompt构建: 在RAG应用中,构建有效的Prompt是至关重要的。Prompt通常包含任务描述、背景知识(基于检索结果)和具体的用户查询。根据不同的应用场景和大模型的特性,Prompt中还可以包括额外的指令或信息,以优化模型的响应。例如,在一个客户服务场景中,一个典型的Prompt可能如下所示:

【任务描述】: {系统提示词} (假设你是一个高级客户服务代表,请根据以下背景知识回答用户问题。)

【背景知识】: {内部检索到的相关信息}(…)

【用户问题】: {用户原始问题} (扫地机器人的续航时间是多久?)

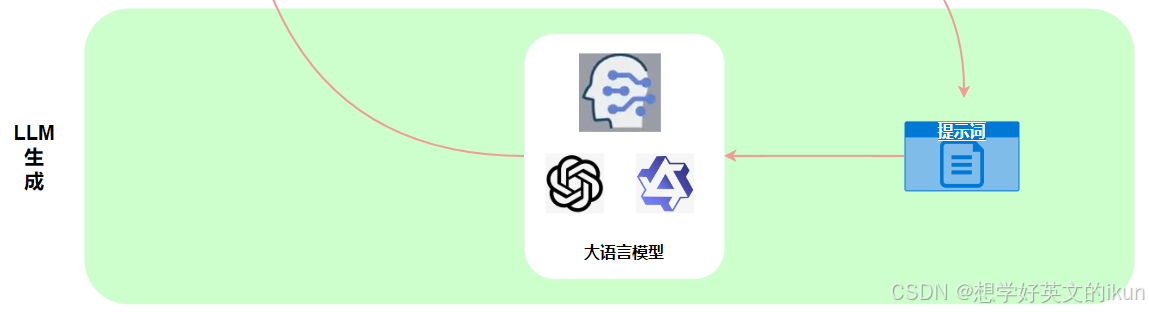

3.2.4 数据生成阶段:

在数据增强阶段后,RAG系统进入关键的生成阶段,其中利用大型语言模型(LLM)来生成响应。该阶段的核心步骤包括:

四、总结

本文深入探讨了检索增强生成(RAG)技术的核心机制和实际应用,明确阐述了其在现代AI系统中的重要性。从数据准备、检索、增强,到最终的大型语言模型生成阶段,RAG通过有效结合外部知识库和高级语言模型,显著提高了生成文本的准确性和相关性。此技术不仅解决了传统语言模型在知识局限性和数据安全性方面的挑战,也优化了响应的时效性和实用性。通过实例展示了RAG如何在不同场景下提供定制化、精准的信息,进一步证明了其在智能问答系统、客户服务和多种其他应用中的实际价值和潜力。总的来说,RAG技术为构建更智能、更灵活的AI响应系统提供了一种高效的解决方案,预示着AI技术在处理复杂问题时的新方向。

登录后可发表评论

点击登录