张士玉小黑屋

一个关注IT技术分享,关注互联网的网站,爱分享网络资源,分享学到的知识,分享生活的乐趣。

当前位置:首页 » 《随便一记》 - 第412页

10 个杀手级的 Python 自动化脚本

发布 : ofheart | 分类 : 《随便一记》 | 评论 : 0 | 浏览 : 443次

重复性任务总是耗时且无聊,想一想你想要一张一张地裁剪100张照片或FetchAPI、纠正拼写和语法等工作,所有这些任务都很耗时,为什么不自动化它们呢?在今天的文章中,我将与你分享10个Python自动化脚本。所以,请你把这篇文章放在你的收藏清单上,以备不时之需,在IT行业里,程序员的学习永无止境……现在,让我们开始吧。01、图片优化器使用这个很棒的自动化脚本,可以帮助把图像处理的更好,你可以像在Photoshop中一样编辑它们。该脚本使用流行的是Pillow模块,你可以在下面找到优化图像所需的大部分方法。在你的图像编辑项目中使用在你的Python项目中使用它批量图像编辑更多# Image Optimizing# pip install

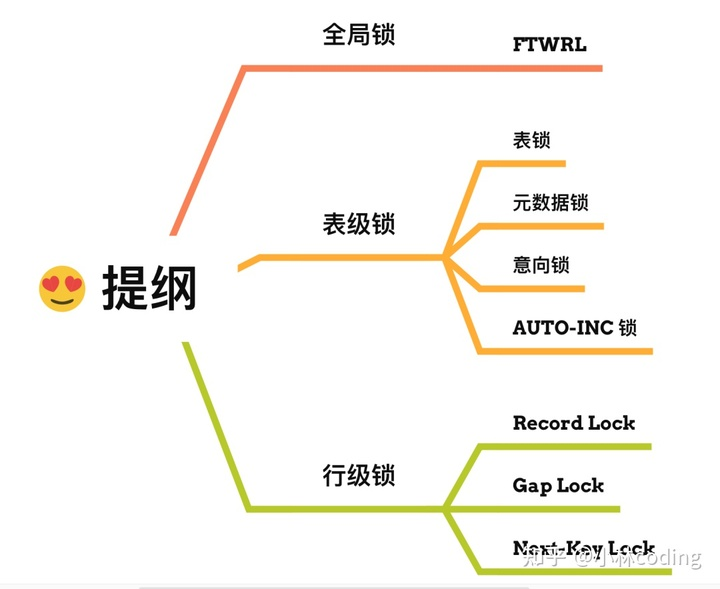

MySQL有哪些锁

发布 : hao1 | 分类 : 《随便一记》 | 评论 : 0 | 浏览 : 425次

这次,来说说 MySQL的锁,主要是Q&A的形式,看起来会比较轻松。在MySQL里,根据加锁的范围,可以分为全局锁、表级锁和行锁三类。全局锁全局锁是怎么用的?要使用全局锁,则要执行这条命:flushtableswithreadlock执行后,整个数据库就处于只读状态了,这时其他线程执行以下操作,都会被阻塞:对数据的增删改操作,比如insert、delete、update等语句;对表结构的更改操作,比如altertable、droptable等语句。如果要释放全局锁,则要执行这条命令:unlocktables当然,当会话断开了,全局锁会被自动释放。全局锁应用场景是什么?全局锁主要应用于做全库逻辑备份,这样在备份数据库期间

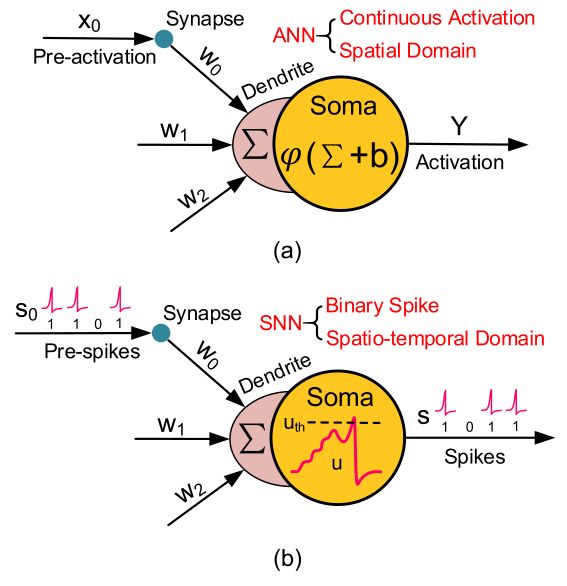

如何看待第三代神经网络SNN?详解脉冲神经网络的架构原理、数据集和训练方法 原创

发布 : jing | 分类 : 《随便一记》 | 评论 : 0 | 浏览 : 2073次

作者丨科技猛兽编辑丨极市平台本文首发于极市平台公众号,转载请获得授权并标明出处。本文目录1脉冲神经网络简介2脉冲神经网络原理3脉冲神经网络数据集4脉冲神经网络训练方法5脉冲神经网络评价指标1脉冲神经网络简介脉冲神经网络(SNN)属于第三代神经网络模型,实现了更高级的生物神经模拟水平。除了神经元和突触状态之外,SNN还将时间概念纳入了其操作之中,是一种模拟大脑神经元动力学的一类很有前途的模型。那么什么是第一代和第二代神经网络模型呢?第一代神经网络第一代神经网络又称为感知器,在1950年左右被提出来,它的算法只有两层,输入层输出层,主要是线性结构。它不能解决线性不可分的问题,对稍微复杂一些的函数都无能为力,如异或操作。第二代神经网络:BP神经网络为

Pytorch:手把手教你搭建简单的全连接网络

发布 : hao | 分类 : 《随便一记》 | 评论 : 0 | 浏览 : 629次

代码里的注释一定要看!!!里面包括了一些基本知识和原因可以依次把下面的代码段合在一起运行,也可以通过jupyternotebook分次运行第一步:一些库的导入importtorch#深度学习的pytoch平台importtorch.nnasnnimportnumpyasnpimportrandomimporttime#可以用来简单地记录时间importmatplotlib.pyplotasplt#画图#随机种子random.seed(1234)np.random.seed(1234)torch.manual_seed(1234)torch.cuda.manual_seed(1234)torch.cuda.manual_seed_all(1234)第二步:构建

图像风格迁移

发布 : jia | 分类 : 《随便一记》 | 评论 : 0 | 浏览 : 850次

文章目录前言一、传统的图像风格迁移(Traditionalstyletransfer)1.1计算机图形学领域和计算机视觉领域(ComputerGraphics&ComputerVision)1.2非真实感图形学(Non-photorealisticgraphics)和纹理迁移(texturetransfer)二、基于神经网络的风格转换(Neuralstyletransfer)2.1基于在线图像优化的慢速图像风格化迁移算法(SlowNeuralMethodBasedOnOnlineImageOptimisation)2.2基于离线模型优化的快速图像风格化迁移算法(FastNeuralMethodBasedOnOfflineModel

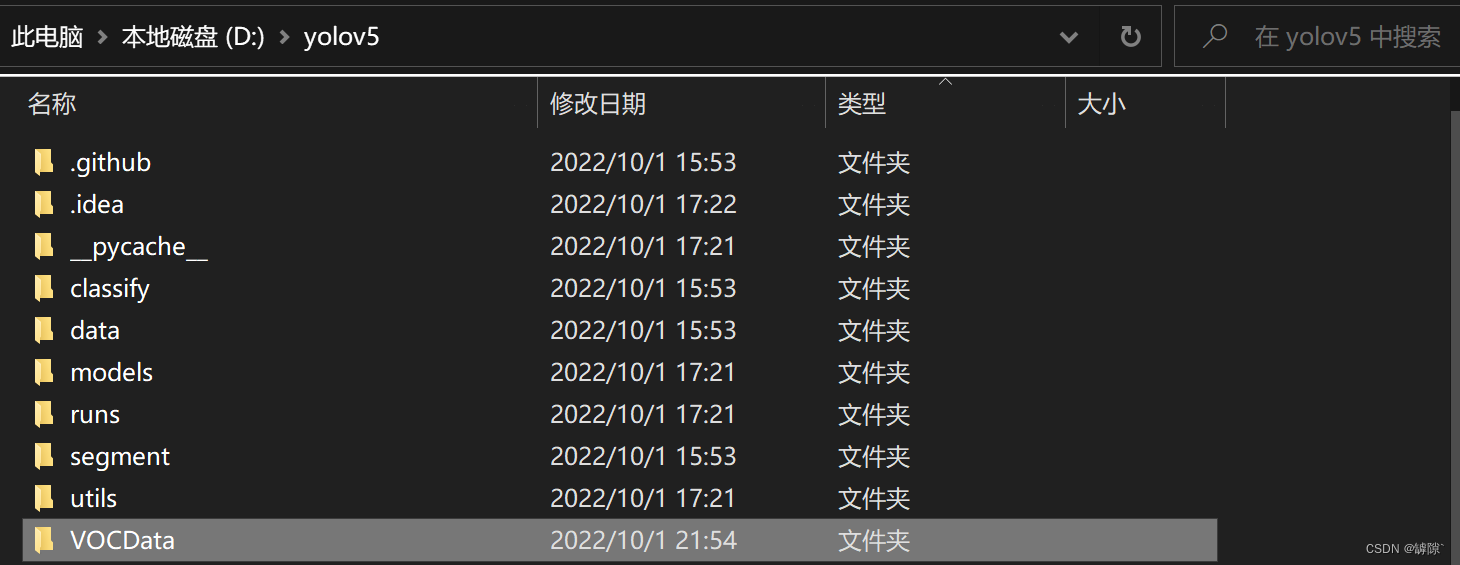

【零基础玩转yolov5】yolov5训练自己的数据集(最新最全版)

发布 : yang | 分类 : 《随便一记》 | 评论 : 0 | 浏览 : 1495次

文章目录一、写在前面二、使用labelimg标记图片1.准备工作2.标记图片三、划分数据集以及配置文件修改1.划分训练集、验证集、测试集2.XML格式转yolo_txt格式3.配置文件4.聚类获得先验框四、使用CPU训练五、使用GPU训练1.开始训练2.重新下载pytorch六、训练结果可视化一、写在前面 博主也是最近开始玩yolov5的,甚至也是最近开始使用python的,很多东西都没有接触过,因此训练自己的数据集花了不少时间,所以想写篇博客记录一下,希望同样是零基础的小伙伴们可以更加轻松的上手。同时大家如果发现了错误和理解偏差,欢迎指正。参考资料:Yolov5训练自己的数据集(详细完整版)训练集、验证集、测试集的划分yolov5训练结果解析关于yol

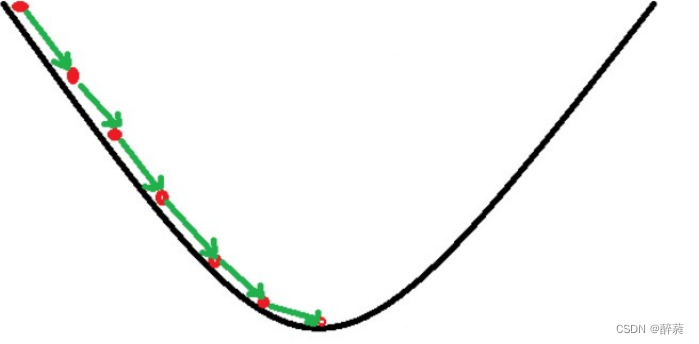

梯度下降算法(Gradient descent)

发布 : hao1 | 分类 : 《随便一记》 | 评论 : 0 | 浏览 : 495次

一、什么是梯度下降算法 首先,我们需要明确梯度下降就是求一个函数的最小值,对应的梯度上升就是求函数最大值。简而言之:梯度下降的目的就是求函数的极小值点,例如在最小化损失函数或是线性回归学习中都要用到梯度下降算法。 ##梯度下降算法作为很多算法的一个关键环节,其重要意义是不言而喻的。 梯度下降算法的思想:先任取点(x0,f(x0)),求f(x)在该点x0的导数f"(x0),在用x0减去导数值f"(x0),计算所得就是新的点x1。然后再用x1减去f"(x1)得x2…以此类推,循环多次,慢慢x值就无限接近极小值点。 损失函数用来衡量机器学习模型的精确度。一般来说,损失函数的值越小,模型的精确度就越高。如果要提高机器学习模型的精确度,就需要尽可

YOLOX优点介绍与解析,详细易懂。

发布 : jie | 分类 : 《随便一记》 | 评论 : 0 | 浏览 : 1631次

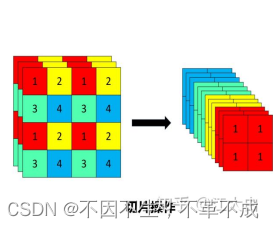

优点1:主干网络(CSPDarknet)加入Fcous结构主干网络加入Fcous结构,将图片宽高信息缩小,减小参数量,提升网络计算速度Fcous结构:将输入的图片先经过Fcos结构对图片进行每隔一个像素取出一个值,得到四个特征层,然后再进行concat。从而图片宽高的信息缩小,通道数增加。在原始信息丢失较少的情况下,减小了参数量(由于fcous替代了两层卷积与一层bottleneck)图1 Fcous示意优点2:主干网络的激活函数替换为silu激活函数silu函数相比于rule非线性能力更强,解决了rule当有负数输入输出为0,发生梯度弥散的缺点。同时继承了relu收敛更快的优点。silu函数=x*sigmoid(x),是relu与sigmoid的结合。可以看做是一个

GAM注意力机制

发布 : ofheart | 分类 : 《随便一记》 | 评论 : 0 | 浏览 : 717次

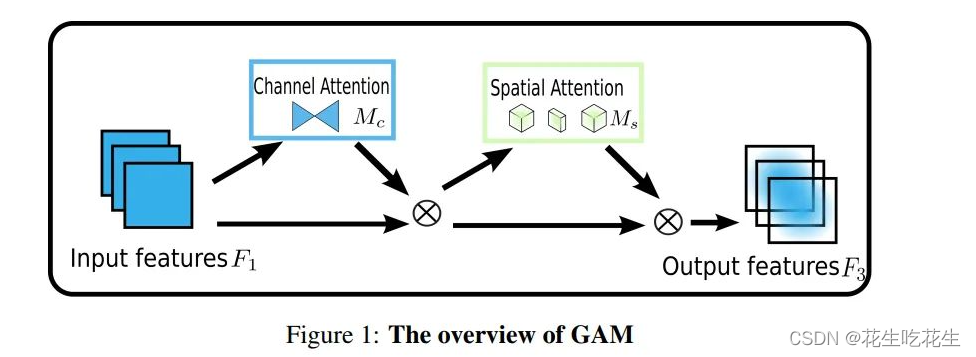

1.GAM注意力机制:图像解析:从整体上可以看出,GAM和CBAM注意力机制还是比较相似的,同样是使用了通道注意力机制和空间注意力机制。但是不同的是对通道注意力和空间注意力的处理。2.CBAM注意力解析CBAM=CAM+BAM对于通道注意力的处理:首先对输入特征图进行最大池化和平均池化,再经过MLP分别处理,最终经过Sigmoid激活。对于空间注意力的处理对特征图进行最大池化和平均池化后叠加在一起,再进行卷积,经过Sigmoid激活函数处理。3.GAM改进了解了CBAM,我们来看GAM是怎么处理CAM和SAM的,同样是先通道后空间。CAM对于输入特征图,首先进行维度转换,经过维度转换的特征图输入到MLP,再转换为原来的维度,进行Sigmoid处理输出。S

全局平均池化/全局最大池化Pytorch实现:

发布 : jing | 分类 : 《随便一记》 | 评论 : 0 | 浏览 : 557次

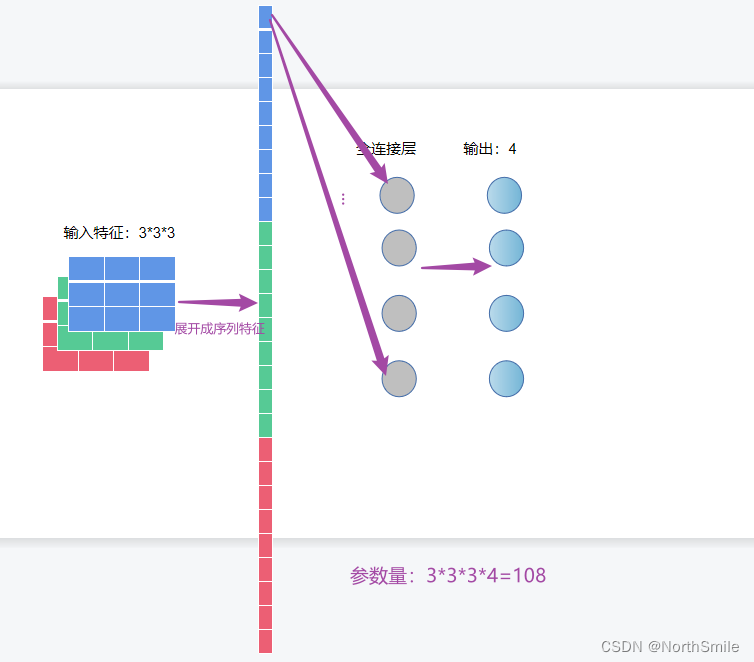

全局池化零、全局池化介绍一、全局平均池化二、全局最大池化零、全局池化介绍普通池化方法汇总详见:https://blog.csdn.net/qq_43665602/article/details/126625116全局池化与普通池化的区别在于“局部区域”和“全局”:普通池化根据滑动窗口以及步长以逐步计算局部区域的方式进行;而全局池化是分别对每个通道的所有元素进行计算,谓之全局池化。全局池化方式的优点:大大降低计算的参数量;没有需要学习的参数,可以更好的避免过拟合;更能体现输入的全局信息;拿一个简单的网络验证参数量下降(此处只计算权重):因为池化操作是沿着通道方向对该通道的特征进行,故对于输入(N,C,H,W),池化输出为(N,C)。此处输入特征为(N,C,H,W)=(1,3,

Copyright © 2020-2022 ZhangShiYu.com Rights Reserved.豫ICP备2022013469号-1